资料内容:

1 传统 Attention 存在哪些问题?

1. 传统 Attention 存在 上下文长度 约束问题;

2. 传统 Attention 速度慢,内存占用大;

2 Attention 优化方向

1. 提升上下文长度

2. 加速、减少内存占用

3 Attention 变体有哪些?

稀疏 attention。将稀疏偏差引入 attention 机制可以降低了复杂性;

• 线性化 attention。解开 attention 矩阵与内核特征图,然后以相反的顺序计算 attention 以实现线性复杂度;

• 原型和内存压缩。这类方法减少了查询或键值记忆对的数量,以减少注意力矩阵的大小;

• 低阶 self-Attention。这一系列工作捕获了 self-Attention 的低阶属性;

• Attention 与先验。该研究探索了用先验 attention 分布来补充或替代标准 attention;

• 改进多头机制。该系列研究探索了不同的替代多头机制。

4 Multi-Query Attention 篇

4.1 Multi-head Attention 存在什么问题?

• 训练过程:不会显著影响训练过程,训练速度不变,会引起非常细微的模型效果损失;

• 推理过程:反复加载 巨大 的 KV cache , 导致 内存开销大,性能是内存受限;

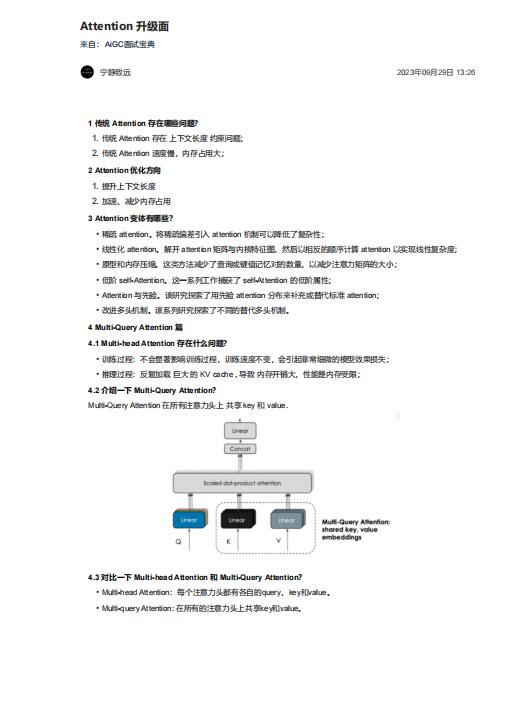

4.2 介绍一下 Multi-Query Attention?

Multi-Query Attention 在所有注意力头上 共享 key 和 value.