资料内容:

一、基于LLM+向量库的文档对话 基础面

1.1 为什么 大模型 需要 外挂(向量)知识库?

如何 将 外部知识 注入 大模型,最直接的方法:利用外部知识对大模型进行微调

既然 大模型微调 不是 将 外部知识 注入 大模型 的 最优方案,那是否有其它可行方案?

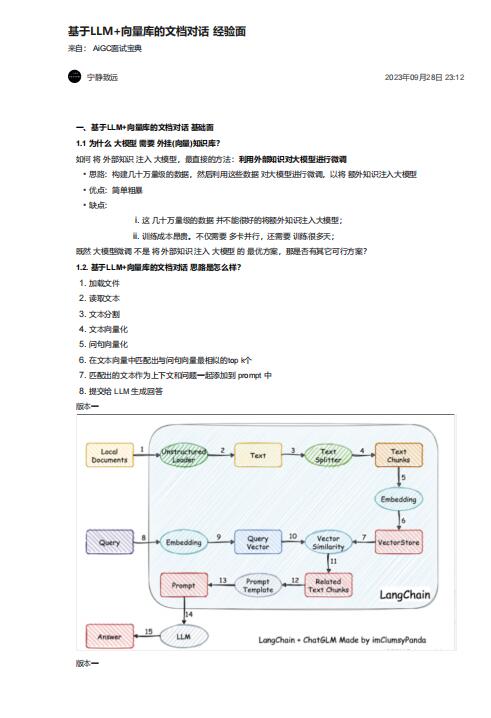

1.2. 基于LLM+向量库的文档对话 思路是怎么样?

版本一

版本一

• 思路:构建几十万量级的数据,然后利用这些数据 对大模型进行微调,以将 额外知识注入大模型

• 优点:简单粗暴

• 缺点:

i. 这 几十万量级的数据 并不能很好的将额外知识注入大模型;

ii. 训练成本昂贵。不仅需要 多卡并行,还需要 训练很多天;

1. 加载文件

2. 读取文本

3. 文本分割

4. 文本向量化

5. 问句向量化

6. 在文本向量中匹配出与问句向量最相似的top k个

7. 匹配出的文本作为上下文和问题一起添加到 prompt 中

8. 提交给 LLM 生成回答